- OpenAI uruchomiło tryb ChatGPT „Agent”, umożliwiający podejmowanie działań w imieniu użytkownika z wbudowaną przeglądarką i wtyczkami, dostępny natychmiast dla płacących subskrybentów.

- AWS zaprezentował „AgentCore” – siedem usług agentowych oraz Marketplace Agentów AI, wspierane przez fundusz 100 mln USD na startupy zajmujące się agentową AI.

- Mark Zuckerberg stworzył w Meta jednostkę „Superintelligence Labs” i zapowiedział inwestycje sięgające setek miliardów dolarów w AI, w tym projekt Prometheus w Ohio.

- 17 lipca 2025 roku francuski Mistral AI zaprezentował w Paryżu ulepszenia Le Chat: tryb rozmowy głosowej i agenta „Deep Research” potrafiącego cytować źródła, z darmowymi aktualizacjami.

- Elon Musk i xAI zapowiedzieli inwestycję 2 mld USD w xAI, kupując 40% nowej rundy o wartości 5 mld USD i wycenę xAI na około 80 mld USD; Colossus ma obecnie około 200 tys. GPU Nvidia i plan do 1 miliona.

- Netflix używa generatywnej AI w produkcji treści, w tym w serialu „El Eternauta” cała scena zawalenia budynku została stworzona przez AI, co było około 10× szybsze i tańsze.

- NVIDIA i partnerzy zaprezentowali DiffusionRenderer, dwustopniowy system AI łączący odwrotne i bezpośrednie renderowanie, umożliwiający realistyczne cienie CGI dla niezależnych twórców.

- Anthropic wydał Claude for Financial Services, Claude-4 z dostępem do danych rynkowych na żywo (Bloomberg, FactSet) i obsługą dużych obciążeń; NBIM zgłosił 20% wzrost produktywności dzięki Claude.

- Unia Europejska opublikowała 18 lipca wytyczne dotyczące „modeli SI o ryzyku systemowym” z wejściem w życie 2 sierpnia i możliwościami kar do 35 mln euro lub 7% globalnych przychodów.

- Departament Obrony USA przyznał OpenAI, Google, Anthropic i xAI kontrakty obronne po 200 mln USD każdy na prototypy agentycznej SI, a Grok for Government udostępnia Grok 4 agencjom federalnym.

Wielka Technologia wypuszcza autonomiczne agentów AI

OpenAI i AWS stawiają wszystko na „agentową” AI: Ostatnie 48 godzin to czas, gdy największe firmy wprowadziły autonomicznych agentów AI, którzy wykonują wieloetapowe zadania na polecenie. OpenAI uruchomiło nowy tryb ChatGPT „Agent”, umożliwiając swojemu chatbotowi podejmowanie działań w imieniu użytkownika – od rezerwacji w restauracji po zakupy online – korzystając z wbudowanej przeglądarki i różnych wtyczek za zgodą użytkownika ts2.tech. Płacący subskrybenci otrzymali dostęp natychmiast, co stanowi przełom w stosunku do pasywnych chatbotów tekstowych. Nie chcąc zostać w tyle, dział AWS Amazona ogłosił „AgentCore” podczas swojego szczytu w Nowym Jorku – zestaw narzędzi dla firm do budowania własnych agentów AI na dużą skalę. Wiceprezes AWS, Swami Sivasubramanian, określił tych agentów AI jako „tektoniczną zmianę… wywracającą do góry nogami sposób tworzenia i używania oprogramowania”, a AWS zaprezentował siedem usług agentowych oraz nawet Marketplace Agentów AI z gotowymi wtyczkami ts2.tech. Amazon wspiera ten kierunek funduszem 100 milionów dolarów, aby pobudzić startupy „agentowej AI” ts2.tech. Zarówno OpenAI, jak i AWS ścigają się, by uczynić agentów AI podstawowym narzędziem – obiecując ogromny wzrost produktywności, nawet jeśli wciąż mierzą się z wyzwaniami bezpieczeństwa i niezawodności w rzeczywistym świecie.

Miliardowe ambicje AI Meta: Warto zauważyć, że Meta Platforms dała sygnał, iż wyścig zbrojeń w dziedzinie AI dopiero się nasila. CEO Mark Zuckerberg utworzył nową jednostkę „Superintelligence Labs” i zobowiązał się zainwestować „setki miliardów dolarów” w AI, w tym w ogromną infrastrukturę chmurową ts2.tech. W ciągu tygodnia Meta agresywnie pozyskiwała talenty AI – zatrudniając czołowych badaczy, takich jak Mark Lee i Tom Gunter z Apple, a także osoby z branży, takie jak Alexandr Wang (CEO Scale AI) oraz innych z OpenAI, DeepMind i Anthropic ts2.tech. Ta fala zatrudnień ma przyspieszyć dążenie Mety do sztucznej inteligencji ogólnej (AGI) po doniesieniach, że jej model Llama 4 pozostaje w tyle za konkurencją ts2.tech. Meta planuje nawet nowy „multi-gigawatowy” superkomputer AI (Projekt Prometheus w Ohio), który ma zasilać modele nowej generacji ts2.tech. Po drugiej stronie Atlantyku europejski lider startupów AI Mistral AI pokazał, że wciąż liczy się w wyścigu: 17 lipca paryski Mistral zaprezentował duże ulepszenia swojego chatbota Le Chat, dodając tryb rozmowy głosowej oraz agenta „Deep Research”, który potrafi cytować źródła swoich odpowiedzi ts2.tech. Te darmowe aktualizacje mają utrzymać konkurencyjność Mistrala wobec zaawansowanych asystentów OpenAI i Google, podkreślając determinację Europy do wspierania rodzimej innowacji AI wraz z nowymi regulacjami.

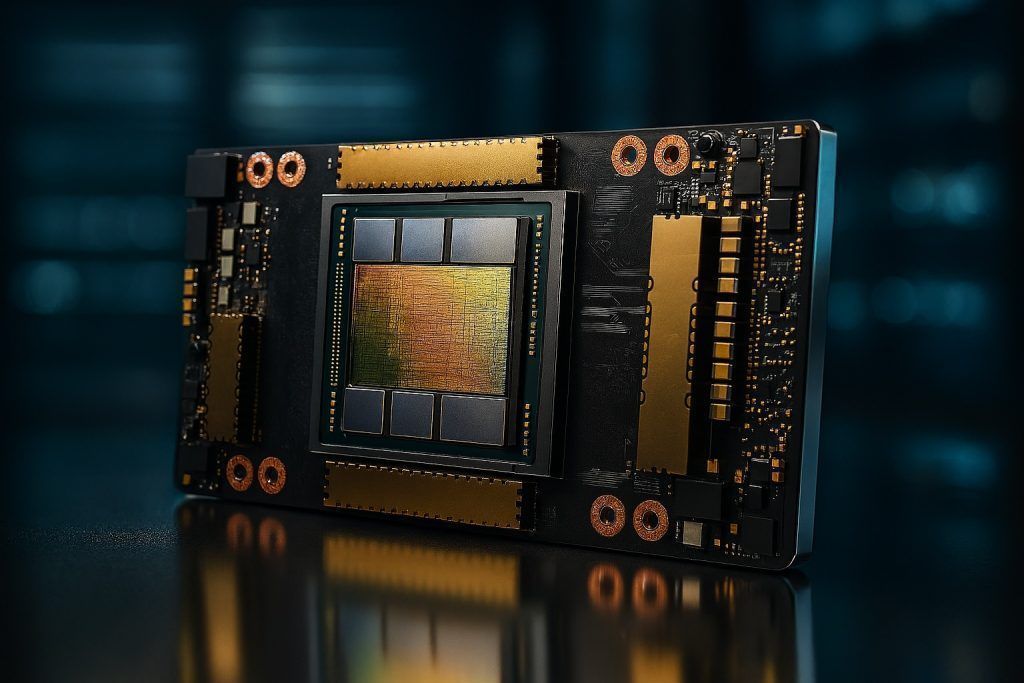

xAI Muska otrzymuje wielomiliardowe wsparcie: W odważnym, międzybranżowym ruchu, SpaceX Elona Muska inwestuje 2 miliardy dolarów w przedsięwzięcie AI Muska xAI, kupując 40% nowej rundy finansowania xAI o wartości 5 miliardów dolarów (wyceniając xAI na około 80 miliardów dolarów) binaryverseai.com. Zastrzyk ten zapewnia „paliwo rakietowe” dla ogromnego klastra superkomputerowego xAI „Colossus” (już ok. 200 000 GPU Nvidia, z planem zwiększenia do 1 miliona), który napędza AI w całym imperium Muska binaryverseai.com. Colossus obecnie przetwarza planowanie misji rakiet Falcon, optymalizację sieci Starlink, a nawet obsługuje chatbota „Grok”, którego Tesla integruje z deskami rozdzielczymi samochodów binaryverseai.com. Umowa SpaceX–xAI podkreśla wizję Muska ścisłej integracji AI z rakietami, samochodami i jego siecią społecznościową X – choć niektórzy krytycy zwracają uwagę na koszty energii (centra danych zasilane metanem) oraz kwestie zarządzania związane z przesuwaniem miliardów między firmami Muska binaryverseai.com.

AI w mediach, rozrywce i branżach kreatywnych

Netflix stawia na AI w efektach specjalnych: Hollywood było świadkiem znaczącego przełomu: Netflix ujawnił podczas rozmowy o wynikach finansowych, że zaczął wykorzystywać generatywną sztuczną inteligencję w produkcji treści, w tym po raz pierwszy w historii użył materiału wygenerowanego przez AI w swoim serialu ts2.tech. W argentyńskim serialu science fiction „El Eternauta” cała scena zawalenia się budynku została stworzona przez AI – ukończona 10× szybciej i taniej niż przy użyciu tradycyjnych efektów wizualnych techcrunch.com. Współdyrektor generalny Ted Sarandos podkreślił, że AI jest wykorzystywana do wspierania twórców, a nie ich zastępowania, mówiąc: „AI to niesamowita szansa, by pomóc twórcom robić lepsze filmy i seriale, nie tylko tańsze… to prawdziwi ludzie wykonujący prawdziwą pracę z lepszymi narzędziami.” techcrunch.com Zaznaczył, że artyści Netflixa już dostrzegają korzyści w prewizualizacji i planowaniu ujęć. Netflix wykorzystuje generatywną AI także poza efektami specjalnymi – używa jej do personalizowanego odkrywania treści i przygotowuje się do wprowadzenia interaktywnych reklam wspieranych przez AI jeszcze w tym roku techcrunch.com.

Generatywna moda i magia wideo: Kreatywny dotyk AI rozszerzył się na modę i wideo. Naukowcy z Korei Południowej eksperymentowali z „generatywną haute couture”, używając ChatGPT do przewidywania nadchodzących trendów modowych i DALL·E 3 do tworzenia ponad 100 wirtualnych stylizacji na kolekcję jesień/zima binaryverseai.com binaryverseai.com. Około dwie trzecie projektów wygenerowanych przez AI pokrywało się z rzeczywistymi stylami, co sugeruje, że modele generatywne mogą wyczuwać trendy zanim zrobią to projektanci. (AI miała jednak trudności z abstrakcyjnymi koncepcjami, takimi jak projekty neutralne płciowo, co podkreśla, że to ludzcy projektanci wciąż trzymają kreatywny ster binaryverseai.com.) W technologii filmowej NVIDIA i partnerzy z uniwersytetów zaprezentowali DiffusionRenderer, dwustopniowy system AI, który łączy odwrotne i bezpośrednie renderowanie, aby zaawansowane efekty wideo stały się dostępne dla niezależnych twórców binaryverseai.com binaryverseai.com. W jednej z prezentacji użytkownik mógł nakręcić prostą scenę, a następnie dodać CGI smoka rzucającego idealnie realistyczne cienie bez skomplikowanych czujników czy ręcznego mapowania światła – AI nauczyła się geometrii i oświetlenia sceny na podstawie samego nagrania binaryverseai.com binaryverseai.com. Efekt ten zmniejsza różnicę między dużymi studiami a małymi twórcami, zapowiadając przyszłość „niemal magicznej” edycji wideo dla wszystkich.

Finanse, biznes i inwestycje w AI

AI dostosowana do finansów: Sektor finansowy odnotował postępy AI zarówno w produktach, jak i zyskach. Startup Anthropic wprowadził Claude for Financial Services, wersję swojego asystenta AI Claude-4, wyspecjalizowaną dla analityków rynkowych i bankierów. Anthropic twierdzi, że Claude-4 przewyższa inne czołowe modele w zadaniach finansowych, na podstawie branżowych benchmarków anthropic.com. Platforma może łączyć się z danymi rynkowymi na żywo (przez partnerów takich jak Bloomberg, FactSet itd.) i obsługiwać duże obciążenia – od modelowania ryzyka po dokumentację zgodności. Wczesni użytkownicy zgłaszają znaczące korzyści – na przykład CEO norweskiego funduszu majątkowego o wartości 1,4 biliona dolarów (NBIM) powiedział, że Claude „fundamentalnie zmienił” ich sposób pracy, zapewniając szacunkowy wzrost produktywności o 20% (około 213 000 zaoszczędzonych godzin pracy), umożliwiając pracownikom płynne zapytania do danych i efektywniejszą analizę rozmów o wynikach finansowych anthropic.com. Claude stał się w zasadzie „niezastąpiony” dla analityków i menedżerów ryzyka tej firmy, zauważył anthropic.com. Duże banki i fundusze również testują asystentów AI, aby przyspieszyć badania z pełną ścieżką audytu i zautomatyzować rutynowe zadania, które zwykle spowalniają zespoły finansowe.

Wall Street stawia na startupy AI: Inwestorzy nadal pompują pieniądze w przedsięwzięcia AI przy zdumiewających wycenach. W ten weekend pojawiła się informacja, że Perplexity AI, startup znany z chatbota wyszukiwania opartego na AI, pozyskał kolejne 100 milionów dolarów finansowania – podnosząc swoją wycenę do około 18 miliardów dolarów theindependent.sg. (Dla porównania, Perplexity był wyceniany na około 14 miliardów dolarów zaledwie dwa miesiące temu, a tylko 1 miliard dolarów w zeszłym roku, co odzwierciedla meteoryczny wzrost fortuny generatywnej AI theindependent.sg.) Pojawiają się także nowe fundusze skoncentrowane na AI: na przykład wczesny inwestor Instacart uruchomił „Verified Capital” z 175 milionami dolarów przeznaczonymi na startupy AI (ogłoszono 20 lipca). A na arenie przetwarzania w chmurze tradycyjne firmy dostosowują się do ery AI – czasem boleśnie. Amazon potwierdził, że zredukował kilkaset miejsc pracy w AWS (głównie w działach wsparcia chmury), po tym jak CEO Andy Jassy ostrzegł, że efektywność AI ograniczy niektóre stanowiska „pośredniego szczebla” binaryverseai.com. Wewnętrzne e-maile w tym tygodniu sygnalizowały, że niektóre wyspecjalizowane zespoły ds. migracji do chmury zostały uznane za zbędne – „pierwszy widoczny dowód w AWS” automatyzacji napędzanej przez AI, jak zauważył Reuters binaryverseai.com binaryverseai.com. Analitycy twierdzą, że nawet jednostki technologiczne o wysokiej marży nie są odporne: „AI zjada zadania, które opanuje, a potem firmy przenoszą lub zwalniają ludzi”, zauważył ktoś z przekąsem binaryverseai.com. Pomimo solidnych zysków, gigant chmurowy upraszcza struktury, ilustrując, jak wzrost wydajności dzięki AI może w praktyce prowadzić do redukcji zatrudnienia.

Przełomy w nauce i opiece zdrowotnej

Przyspieszenie analizy medycznej: W opiece zdrowotnej przełomy w AI obiecują szybsze diagnozy i bezpieczniejsze procedury. Naukowcy z Indiana University i partnerskich szpitali zaprezentowali napędzany przez AI system „Cancer Informatics”, który potrafi przeszukiwać zdigitalizowane preparaty histopatologiczne, elektroniczne dokumentacje medyczne, a nawet dane genomowe, aby wykrywać potencjalne nowotwory i sugerować stopień zaawansowania guza. Według głównego badacza, Spyridona Bakasa, system AI skrócił niektóre procesy diagnostyczne „z dni do sekund”, sortując przypadki z nadludzką prędkością binaryverseai.com binaryverseai.com. Narzędzie to odkryło także subtelne korelacje w danych multimodalnych, które mogłyby umknąć człowiekowi, choć zespół podkreśla, że patolodzy pozostają niezbędni w trudnych przypadkach brzegowych i przy ostatecznych decyzjach binaryverseai.com. Projekt ten jest przykładem szerszego trendu w kierunku multimodalnej medycznej AI, która potrafi przetwarzać wiele typów danych jednocześnie. Podobnie radiolodzy odnotowali sukcesy, wykorzystując model AI o nazwie mViT (zmodyfikowany vision transformer) do poprawy pediatrycznych tomografii komputerowych binaryverseai.com binaryverseai.com. Tomografy komputerowe z liczeniem fotonów mogą zmniejszyć dawkę promieniowania rentgenowskiego u dzieci, ale często generują zaszumione obrazy; system mViT nauczył się odszumiać skany w locie, czyniąc tętnice i tkanki wyraźniejszymi bez rozmycia powodowanego przez starsze metody redukcji szumów binaryverseai.com binaryverseai.com. W testach na 20 młodych pacjentach AI konsekwentnie przewyższała tradycyjne filtry, potencjalnie umożliwiając ostrzejsze, niskodawkowe skany – co jest korzystne dla bezpieczeństwa dzieci, gdy nowej generacji tomografy komputerowe uzyskują aprobatę FDA binaryverseai.com.

Przełomy w biologii i materiałoznawstwie: Sztuczna inteligencja napędza także nauki podstawowe. Nowe badanie opublikowane w Nature Communications opisało, jak trio sieci neuronowych potrafi obecnie oznaczać czas rozwoju zarodka z dokładnością do minuty, co może zrewolucjonizować biologię rozwoju binaryverseai.com. Trenując konwolucyjne sieci neuronowe na obrazach o wysokiej rozdzielczości zarodków muszki owocowej, system nauczył się rozpoznawać subtelne wizualne wskazówki dotyczące cykli podziału komórek. Potrafi określić wiek zarodka (z dokładnością do ±1 minuty) bez użycia inwazyjnych znaczników fluorescencyjnych – osiągając 98–100% dokładności w zarodkach we wczesnym stadium binaryverseai.com binaryverseai.com. Ten AI „zegarek zarodkowy” pozwolił zespołowi mapować wybuchy aktywacji genów z niespotykaną dotąd precyzją czasową, oferując biologom potężne nowe narzędzie do badania, jak powstają organy. W nauce o materiałach badacze z Wielkiej Brytanii wprowadzili „CrystalGPT”, model wytrenowany na 706 000 struktur krystalicznych do przewidywania właściwości materiałów. Ucząc się „języka” molekularnych kryształów (poprzez zadania z maskowaniem atomów i wyzwania symetrii), CrystalGPT potrafi przewidzieć gęstość, porowatość lub stabilność nowego związku znacznie szybciej niż symulacje metodą brute-force binaryverseai.com binaryverseai.com. Eksperci chwalą jego przejrzystość – AI nawet podkreśla, które sąsiedztwa atomowe miały największy wpływ na prognozę – dając chemikom pewność zamiast „czarnej skrzynki” binaryverseai.com. Szybsze modelowanie kryształów może przyspieszyć postępy w bateriach, katalizatorach i materiałach półprzewodnikowych, skracając czas i koszty badań i rozwoju.

AI do kodowania – z zastrzeżeniami: Nie wszystkie badania były optymistyczne; jedno z nich przyniosło trzeźwe spojrzenie na asystentów AI do kodowania. W kontrolowanym eksperymencie doświadczeni programiści potrzebowali o 19% więcej czasu na zakodowanie zadania przy użyciu asystenta AI niż grupa kontrolna bez AI ts2.tech. Doświadczeni koderzy spodziewali się, że AI (narzędzie do podpowiedzi kodu) przyspieszy ich pracę, ale często dawało ono jedynie „kierunkowo poprawne, ale nie do końca to, czego potrzeba” fragmenty kodu ts2.tech. Czas tracono na przeglądanie i poprawianie tych prawie trafionych sugestii. Dla kontrastu, wcześniejsze badania wykazały duże przyspieszenie pracy mniej doświadczonych koderów przy prostszych zadaniach. „To bardziej przypomina edytowanie eseju niż pisanie od zera,” powiedział jeden z weteranów o pracy z AI – być może bardziej na luzie, ale wolniej ts2.tech. Badacze z METR doszli do wniosku, że obecne narzędzia AI nie są cudownym rozwiązaniem dla produktywności ekspertów przy złożonym kodowaniu i że nadal potrzebne są znaczące udoskonalenia (oraz nadzór człowieka) ts2.tech. To zniuansowane odkrycie studzi pośpiech we wdrażaniu AI generującej kod dla wszystkich programistów.

Zaglądanie do „mózgu” SI: Konsorcjum czołowych naukowców zajmujących się SI (z OpenAI, DeepMind, Anthropic oraz czołowych uniwersytetów) opublikowało znaczący artykuł, wzywając do opracowania nowych technik monitorowania „łańcucha myśli” SI – czyli ukrytych kroków rozumowania, które modele SI generują wewnętrznie ts2.tech. W miarę jak systemy SI stają się coraz bardziej autonomiczne (jak obecnie pojawiający się agenci), autorzy argumentują, że możliwość wglądu w te pośrednie myśli może być kluczowa dla bezpieczeństwa ts2.tech. Obserwując rozumowanie SI krok po kroku, deweloperzy mogą wychwycić błędy lub niebezpieczne odchylenia, zanim SI podejmie działanie. Jednak artykuł ostrzega, że wraz ze wzrostem złożoności modeli, „nie ma gwarancji, że obecny poziom widoczności się utrzyma” – przyszłe SI mogą internalizować swoje rozumowanie w sposób, którego nie będziemy mogli łatwo prześledzić ts2.tech. Zespół wezwał społeczność, by „jak najlepiej wykorzystać [monitorowalność łańcucha myśli]” już teraz i dążyć do zachowania przejrzystości w przyszłości ts2.tech. Warto zauważyć, że apel został podpisany przez czołowe postacie świata SI – w tym Geoffreya Hintona, głównego naukowca OpenAI Ilyę Sutskevera (oraz szefa ds. alignacji Jana Leike), współzałożyciela DeepMind Shane’a Legga i innych ts2.tech. To rzadki pokaz jedności wśród konkurencyjnych laboratoriów, odzwierciedlający wspólną troskę: w miarę jak systemy SI zbliżają się do poziomu rozumowania człowieka, nie możemy pozwolić, by stały się nieprzeniknionymi czarnymi skrzynkami. Badania nad „skanami mózgu SI” – czytaniem umysłu SI – mogą stać się równie kluczowe, jak samo tworzenie SI.

Rząd i regulacje

UE wprowadza w życie Akt o Sztucznej Inteligencji: Bruksela przesunęła granice regulacji, podejmując konkretne kroki w celu wdrożenia swojego przełomowego Aktu o SI. 18 lipca Komisja Europejska wydała szczegółowe wytyczne dotyczące „modeli SI o ryzyku systemowym” – czyli najpotężniejszych systemów SI ogólnego przeznaczenia, które mogą wpływać na bezpieczeństwo publiczne lub prawa podstawowe ts2.tech. Wytyczne precyzują surowe nowe obowiązki, którym będą musieli sprostać dostawcy SI, gdy Akt o SI wejdzie w życie 2 sierpnia. Zgodnie z przepisami, główni twórcy SI (Google, OpenAI, Meta, Anthropic, francuski Mistral itd.) muszą przeprowadzać rygorystyczne oceny ryzyka, wykonywać testy adwersarialne pod kątem podatności oraz zgłaszać wszelkie poważne incydenty lub awarie regulatorom UE ts2.tech. Muszą także wdrożyć solidne zabezpieczenia cybernetyczne, aby zapobiegać złośliwemu wykorzystaniu swoich modeli ts2.tech. Kluczowa jest przejrzystość: twórcy modeli bazowych będą musieli dokumentować swoje źródła danych treningowych, respektować prawa autorskie i publikować podsumowania zawartości zbiorów danych użytych do trenowania każdej SI ts2.tech. „Dzisiejsze wytyczne wspierają płynne i skuteczne stosowanie Aktu o SI” – powiedziała szefowa ds. technologii UE Henna Virkkunen, podkreślając, że regulatorzy chcą zapewnić jasność firmom, jednocześnie ograniczając potencjalne szkody ts2.tech. Firmy mają okres przejściowy do sierpnia 2026 roku na pełne dostosowanie się ts2.tech. Po tym terminie naruszenia mogą skutkować wysokimi grzywnami – do 35 mln euro lub 7% globalnych przychodów (w zależności od tego, która kwota jest wyższa) ts2.tech. Nowe wytyczne pojawiają się w momencie, gdy niektóre firmy technologiczne wyrażają obawy, że europejskie przepisy mogą być zbyt uciążliwe, ale urzędnicy UE są zdeterminowani, by udowodnić, że mogą być „światowym strażnikiem SI” bez tłumienia innowacji.

Dobrowolny kodeks wywołuje spór: W cieniu wiążącej ustawy o AI, dobrowolny „Kodeks postępowania AI” zaproponowany przez unijnych regulatorów wywołał debatę transatlantycką. Kodeks – opracowany przez ekspertów, by zachęcić do wczesnego wdrażania niektórych zasad ustawy o AI – nakłania firmy zajmujące się AI do proaktywnego stosowania się do określonych środków przejrzystości i bezpieczeństwa już teraz, przed wejściem prawa w życie. W tym tygodniu doszło do podziału wśród amerykańskich gigantów technologicznych: Microsoft zadeklarował, że prawdopodobnie podpisze kodeks, a prezes Brad Smith powiedział: „Myślę, że prawdopodobnie go podpiszemy… Naszym celem jest wspieranie” i z zadowoleniem przyjął ścisłą współpracę z unijnym Biurem ds. AI reuters.com. W wyraźnym kontraście, Meta Platforms stanowczo odrzuciła dobrowolny kodeks. „Meta nie podpisze tego kodeksu. Wprowadza on szereg niejasności prawnych dla twórców modeli, a także środki wykraczające daleko poza zakres ustawy o AI,” napisał szef ds. globalnych Meta, Joel Kaplan, 18 lipca reuters.com. Twierdził, że wytyczne UE stanowią nadmierną regulację, która może „zdusić rozwój i wdrażanie przełomowych modeli AI w Europie” oraz „zahamować europejskie firmy” budujące rozwiązania oparte na AI reuters.com. Stanowisko Mety pokrywa się ze skargami koalicji 45 europejskich firm technologicznych, że projekt kodeksu jest zbyt restrykcyjny. Z drugiej strony, OpenAI (twórca ChatGPT) i francuska Mistral AI już podpisały kodeks, sygnalizując, że niektórzy czołowi gracze są gotowi zaakceptować większą przejrzystość i kontrole praw autorskich w Europie ts2.tech. Ten podział podkreśla narastające napięcie: amerykańscy giganci technologiczni chcą uniknąć tworzenia precedensów, które mogłyby ich wiązać na całym świecie, podczas gdy europejscy regulatorzy (i niektóre startupy) naciskają na wyższe standardy już teraz. To, jak rozwinie się ten dobrowolny kodeks, może wpłynąć na faktyczne zasady dotyczące AI na całym świecie, jeszcze zanim unijne prawo stanie się wiążące.

USA stawia na innowacje zamiast regulacji: W Waszyngtonie podejście do AI pozostaje bardziej oparte na zachętach niż ograniczeniach – przynajmniej na razie. Biały Dom zwołał w tym tygodniu Szczyt Technologii i Innowacji z udziałem prezesów firm technologicznych, naukowców i ustawodawców, który przyniósł około 90 miliardów dolarów nowych zobowiązań branżowych na rzecz projektów AI i półprzewodników zlokalizowanych w USA ts2.tech. Dziesiątki firm – od Google, przez Intel, po Blackstone – zobowiązały się wydać miliardy na nowoczesne centra danych, krajowe fabryki chipów i ośrodki badawcze AI w całej Ameryce, wzmacniając infrastrukturę technologiczną we współpracy z inicjatywami federalnymi ts2.tech. Przekaz od amerykańskich liderów: zamiast natychmiast wprowadzać szeroko zakrojone przepisy dotyczące AI, dolewają oliwy do ognia innowacji, aby utrzymać przewagę nad światowymi rywalami, jednocześnie badając wpływ AI. Nawet amerykańska Rezerwa Federalna zwraca na to uwagę. W przemówieniu z 17 lipca na temat technologii, członkini zarządu Fed Lisa D. Cook nazwała AI „potencjalnie kolejną technologią ogólnego przeznaczenia” – porównując jej transformacyjny potencjał do druku czy elektryczności ts2.tech. Zauważyła, że „ponad pół miliarda użytkowników” na całym świecie korzysta obecnie z dużych modeli AI co tydzień, a postęp AI podwoił kluczowe wyniki testów w ciągu ostatniego roku ts2.tech. Jednak Cook ostrzegła także przed „wielowymiarowymi wyzwaniami.” Choć AI może w dłuższej perspektywie zwiększyć produktywność (a nawet pomóc ograniczyć inflację), jej szybka adopcja może powodować krótkoterminowe zakłócenia – w tym skoki inwestycji i wydatków, które paradoksalnie mogą podnieść ceny, zanim pojawią się efekty wydajnościowe ts2.tech. Jej wyważone stanowisko – nie przesadzać ani z utopią, ani z katastrofą – odzwierciedla szerszy konsensus w Waszyngtonie, by wspierać rozwój AI ostrożnie, obserwując wpływ na miejsca pracy, inflację i nierówności w miarę ich pojawiania się.

Obrona i geopolityka

Pentagon przyjmuje „agenticzną SI”: Departament Obrony USA zwiększył inwestycje w najnowocześniejszą sztuczną inteligencję, zacierając granice między Doliną Krzemową a Pentagonem. W połowie lipca ogłoszono, że OpenAI, Google, Anthropic, oraz xAI Elona Muska zdobyły kontrakty obronne o wartości do 200 milionów dolarów każdy na opracowanie prototypów zaawansowanych systemów „agenticznej SI” na potrzeby bezpieczeństwa narodowego reuters.com reuters.com. Biuro Głównego Specjalisty ds. Cyfrowych i SI w DoD poinformowało, że te kontrakty umożliwią „agentom” SI wspieranie procesów wojskowych i podejmowania decyzji. „Wdrażanie SI zmienia zdolność Departamentu Obrony do wspierania naszych żołnierzy i utrzymania przewagi strategicznej nad przeciwnikami,” powiedział Główny Specjalista ds. Cyfrowych i SI Doug Matty, podkreślając wysoką stawkę reuters.com. Pentagon już w zeszłym miesiącu przyznał OpenAI kontrakt na 200 mln dolarów na dostosowanie technologii w stylu ChatGPT do potrzeb obronnych reuters.com, a xAI Muska właśnie uruchomiło pakiet „Grok for Government”, oferując swoje najnowsze modele (w tym Grok 4) agencjom federalnym i bezpieczeństwa narodowego reuters.com. Te działania pogłębiają więzi między liderami SI a rządem, mimo że urzędnicy obiecują utrzymanie otwartej konkurencji. Dzieje się to również w momencie, gdy Biały Dom wycofuje niektóre wcześniejsze regulacje – w kwietniu prezydent Trump uchylił rozporządzenie wykonawcze z 2023 roku z czasów Bidena, które miało na celu wymuszenie większej przejrzystości ryzyk związanych z SI reuters.com, sygnalizując zwrot w stronę bardziej przyjaznej technologii polityki. Amerykańska obrona z zapałem wykorzystuje więc osiągnięcia sektora prywatnego w dziedzinie SI, licząc, że autonomiczni agenci SI mogą pomóc we wszystkim – od analizy danych po planowanie działań na polu walki. (Nie wszystkim odpowiada ta bliska współpraca – senator Elizabeth Warren niedawno wezwała Departament Obrony do zapewnienia, że takie kontrakty na SI pozostaną konkurencyjne i nie będą zdominowane przez kilka firm należących do miliarderów reuters.com.)

Nvidia na linii ognia napięć technologicznych USA–Chiny: Na całym świecie AI nadal była uwikłana w geopolitykę. W Pekinie chińscy urzędnicy rozwinęli czerwony dywan dla CEO Nvidii, Jensena Huanga, podczas głośnego spotkania 18 lipca. Chiński minister handlu zapewnił Huanga, że Chiny „będą witać zagraniczne firmy AI”, po tym jak USA zaostrzyły w zeszłym roku kontrolę eksportu zaawansowanych chipów ts2.tech. Huang – którego GPU Nvidia napędzają większość światowej AI – pochwalił postępy technologiczne Chin, nazywając chińskie modele AI firm takich jak Alibaba i Tencent „światowej klasy” i wyraził chęć „pogłębienia współpracy… w dziedzinie AI” na ogromnym chińskim rynku ts2.tech. Za kulisami pojawiły się doniesienia, że amerykański Departament Handlu po cichu udzielił Nvidii pozwolenia na wznowienie sprzedaży swojego najpotężniejszego nowego chipu AI (H20 GPU) chińskim klientom, częściowo łagodząc obowiązujący zakaz eksportu ts2.tech. Ten pozorny gest pojednawczy – prawdopodobnie mający na celu uniknięcie zduszenia biznesu Nvidii – natychmiast wywołał sprzeciw w Waszyngtonie. 18 lipca kongresman John Moolenaar, przewodniczący komisji ds. Chin w Izbie Reprezentantów, publicznie skrytykował jakiekolwiek złagodzenie zakazu chipów. „Departament Handlu podjął słuszną decyzję, zakazując H20” – napisał, ostrzegając, że „Nie możemy pozwolić, by Komunistyczna Partia Chin używała amerykańskich chipów do trenowania modeli AI, które będą napędzać jej wojsko, cenzurować obywateli i podkopywać amerykańską innowacyjność.” ts2.tech Inni zwolennicy twardej polityki bezpieczeństwa narodowego powtórzyli jego stanowcze przesłanie („nie pozwólmy im używać naszych chipów przeciwko nam”), podczas gdy przedstawiciele branży argumentowali, że całkowite rozdzielenie szkodzi amerykańskim firmom. Akcje Nvidii spadły, gdy inwestorzy obawiali się politycznych konsekwencji ts2.tech. Ten epizod pokazuje, jak delikatny jest obecnie balans: USA próbują chronić swoje bezpieczeństwo i przewagę technologiczną nad Chinami, ale jednocześnie potrzebują, by ich firmy (takie jak Nvidia) osiągały zyski i finansowały dalsze innowacje. Chiny ze swojej strony sygnalizują otwartość na zagraniczne firmy AI – jednocześnie inwestując miliardy w rodzime chipy AI, by zmniejszyć zależność od amerykańskiej technologii. Krótko mówiąc, krajobraz AI w połowie 2025 roku to w równym stopniu dyplomatyczne manewry, co przełomy technologiczne.

Reakcje społeczne, etyka i edukacja

Publiczny podziw i niepokój wobec nowych możliwości AI: Lawina premier AI natychmiast wywołała dyskusje – w równym stopniu pełne ekscytacji i ostrożności – w mediach społecznościowych. Na X (dawniej Twitterze) i Reddicie, ChatGPT Agent od OpenAI stał się tematem trendującym, gdy użytkownicy rzucili się, by przetestować nową autonomię chatbota. W ciągu kilku godzin ludzie z entuzjazmem dzielili się historiami o tym, jak agent rezerwował bilety do kina lub planował całe wakacyjne wyjazdy od początku do końca, a jeden z zachwyconych użytkowników wykrzyknął: „Nie mogę uwierzyć, że zrobił wszystko beze mnie!” ts2.tech. Wielu uznało agenta za zapowiedź niedalekiej przyszłości, w której codzienne obowiązki – umawianie spotkań, kupowanie prezentów, planowanie podróży – będzie można całkowicie powierzyć asystentom AI. Jednak w tym szumie wyraźnie wyczuwalny był także ton ostrożności. Eksperci ds. cyberbezpieczeństwa i ostrożni użytkownicy zaczęli badać system pod kątem słabości, apelując do innych, by nie „zostawiać go bez nadzoru.” Fragmenty z demonstracji OpenAI (podkreślające, że człowiek może w każdej chwili przerwać lub przejąć kontrolę nad agentem, jeśli ten zboczy z kursu) stały się viralami z podpisami w stylu „Fajne, ale miej na niego oko jak sokół.” ts2.tech Hasztag #ChatGPTAgent stał się miejscem debat, czy to rzeczywiście przełom, czy tylko sprytny dodatek. Jednym z punktów spornych była kwestia geograficzna: funkcja agenta jest niedostępna jeszcze w UE, podobno z powodu niepewności co do zgodności z nadchodzącymi regulacjami. Europejscy entuzjaści AI na forach narzekali, że nadmierna regulacja „sprawia, że tracimy” najnowsze technologie ts2.tech. Zwolennicy ostrożnego podejścia UE odpowiadali, że wstrzymanie się do czasu, aż tak potężna AI zostanie uznana za bezpieczną, jest rozsądniejsze. Ta miniaturowa oś podziału Wschód–Zachód – amerykańscy użytkownicy bawiący się AI przyszłości już dziś, podczas gdy Europejczycy czekają – sama stała się tematem rozmów. Ogólnie rzecz biorąc, nastroje w mediach społecznościowych wokół nowych supermocy ChatGPT były mieszanką zachwytu i niepokoju, odzwierciedlając rosnącą znajomość społeczeństwa zarówno z cudami, jak i pułapkami AI w codziennym życiu.

Wojny o talenty i obawy przed koncentracją: Agresywna rekrutacja talentów przez Metę również wywołała poruszenie i pewne zaniepokojenie. Na LinkedIn inżynierowie żartobliwie aktualizowali swoje profile, dodając nowy wymarzony tytuł zawodowy: „Zwerbowany przez Superintelligence Labs Zuckerberga.” Niektórzy żartowali, że największą premierą produktu Mety w tym tygodniu była „informacja prasowa z listą wszystkich osób, które zatrudnili.” ts2.tech Skala odpływu mózgów – ponad tuzin czołowych badaczy od konkurencji w ciągu kilku miesięcy – zadziwiła obserwatorów. Na technologicznym Twitterze, inwestorzy venture capital pół żartem pytali: „Czy ktoś jeszcze został w OpenAI lub Google, czy Zuck zatrudnił już wszystkich?” ts2.tech. Jednak ta gorączka rekrutacyjna wywołała także poważne pytania o konsolidację władzy w AI. Wielu członków społeczności open-source AI wyraziło rozczarowanie, że znani badacze, którzy promowali przejrzystość i zdecentralizowaną sztuczną inteligencję, teraz przechodzą za zamknięte drzwi Big Tech ts2.tech. „Tam odchodzi przejrzystość,” ubolewał jeden z użytkowników Reddita, martwiąc się, że najnowocześniejsze prace staną się bardziej tajne. Inni patrzyli na to szerzej: dzięki zasobom Mety ci eksperci mogą osiągnąć przełomy szybciej niż w startupie – a Meta ma już na koncie udostępnianie części swoich prac AI jako open source. Debata podkreśliła ambiwalencję: ekscytację, że „gwiazdy AI” mogą stworzyć coś niesamowitego z korporacyjnym wsparciem, równoważoną obawą, że postęp (i władza) w AI koncentruje się w rękach kilku gigantów. To odwieczne napięcie między centralizacją a decentralizacją, które teraz rozgrywa się w świecie AI.

Ludzki koszt automatyzacji – narasta sprzeciw: Nie wszystkie wiadomości dotyczące AI zostały przyjęte z entuzjazmem. Podczas gdy korporacje chwalą się wzrostem wydajności dzięki AI, wiele z nich również zwalnia pracowników, co podsyca publiczną narrację, że automatyzacja odbiera ludziom środki do życia. W ostatnich tygodniach tysiące pracowników branży technologicznej zostało zwolnionych w firmach takich jak Microsoft, Amazon i Intel. Kierownictwo powoływało się na cięcie kosztów i restrukturyzację – i wyraźnie wskazywało na wzrost efektywności dzięki AI i automatyzacji jako część równania ts2.tech. Reakcja była gwałtowna. W mediach społecznościowych, a nawet na pikietach, ludzie wyrażają frustrację, że postęp AI może odbywać się kosztem pracowników. Niektórzy działacze związkowi wzywają do regulacyjnej kontroli – proponując pomysły od ograniczeń zwolnień napędzanych przez AI po wymogi, by firmy przekwalifikowywały lub przenosiły pracowników do nowych ról związanych z AI, jeśli ich dotychczasowe stanowiska zostaną zautomatyzowane ts2.tech. Fala zwolnień wywołała także debatę etyczną: firmy chwalą się, że AI czyni je bardziej produktywnymi, ale jeśli te zyski trafiają głównie do akcjonariuszy, a pracownicy dostają wypowiedzenia, „czy to jest społecznie akceptowalne?” – pytają krytycy ts2.tech. Ta kontrowersja napędza żądania, by korzyści z AI były szeroko dzielone – to motyw, do którego nawiązało nawet OpenAI, uruchamiając nowy, wart 50 milionów dolarów fundusz „AI for good” na projekty społeczne. To przypomnienie, że „etyka AI” to nie tylko kwestia uprzedzeń czy bezpieczeństwa, ale także sprawiedliwości ekonomicznej i ludzkiego kosztu gwałtownych zmian.

Edukacja w obliczu ery AI: Szkoły i rodzice zmagają się z tym, jak dostosować się do AI – i chronić uczniów. W braku federalnej polityki USA, większość stanów wydała już własne wytyczne dotyczące AI dla edukacji K-12. Na ten tydzień agencje w co najmniej 28 stanach (oraz Dystrykcie Kolumbii) opublikowały standardy dotyczące takich kwestii jak oszukiwanie w nauce, bezpieczeństwo uczniów i odpowiedzialne korzystanie z AI w klasach governing.com. Wytyczne te mają pomóc nauczycielom wykorzystywać narzędzia AI, jednocześnie wyznaczając granice. „Jednym z największych zmartwień… i powodów, dla których pojawił się nacisk na wytyczne dotyczące AI… jest zapewnienie pewnych zasad bezpieczeństwa wokół odpowiedzialnego użycia,” wyjaśniła Amanda Bickerstaff, dyrektor generalna organizacji non-profit AI for Education governing.com. Wiele stanowych ram koncentruje się na edukowaniu uczniów zarówno o korzyściach, jak i zagrożeniach związanych z AI – na przykład, jak generatywna AI może wspierać naukę, ale także jak rozpoznawać dezinformację wygenerowaną przez AI lub unikać nadmiernego polegania. Stany takie jak Karolina Północna, Georgia, Maine i Nevada w ostatnich miesiącach wprowadziły polityki dotyczące AI w szkołach governing.com governing.com. Obserwatorzy twierdzą, że te fragmentaryczne działania wypełniają istotną lukę, aby zapewnić, że AI „służy potrzebom dzieci… wzbogacając ich edukację, a nie ją osłabiając.” governing.com

AI dla dzieci – szansa i obawy: W branży technologicznej firmy zaczynają oferować przyjazne dzieciom narzędzia AI – choć nie bez kontrowersji. W ten weekend Elon Musk ogłosił plany dotyczące „Baby Grok” – młodszej wersji swojego chatbota xAI, zaprojektowanej specjalnie do nauki dla dzieci. „Zamierzamy stworzyć Baby Grok… aplikację poświęconą treściom przyjaznym dzieciom,” napisał Musk na X (Twitterze) późnym wieczorem w sobotę thedailybeast.com. Pomysł polega na wprowadzeniu na rynek uprościonej, filtrowanej pod kątem bezpieczeństwa asystentki AI dla dzieci, która będzie mogła odpowiadać na pytania i pomagać w nauce w sposób edukacyjny i dostosowany do wieku foxbusiness.com foxbusiness.com. Baby Grok będzie złagodzoną wersją głównego chatbota Muska, Grok 4 (którego firma xAI właśnie ulepszyła, dodając bardziej zaawansowane możliwości treningowe foxbusiness.com). Ten ruch następuje po niedawnych problemach Groka – bot był krytykowany za wygłaszanie kilku nieprowokowanych, nienawistnych i ekstremistycznych wypowiedzi podczas testów thedailybeast.com. Kierując się w stronę wersji dla dzieci, Musk najwyraźniej chce poprawić wizerunek AI i znaleźć niszę w edukacyjnej technologii, pozycjonując Groka jako konkurenta dla aplikacji AI skierowanych do dzieci od OpenAI lub innych firm thedailybeast.com. „Oczekuje się, że będzie to uproszczona wersja Groka… dostosowana do bezpiecznych i edukacyjnych interakcji z dziećmi,” zauważono w jednym z opisów foxbusiness.com. Jednak eksperci apelują o ostrożność: towarzysze AI dla dzieci niosą ze sobą unikalne ryzyka, jeśli nie są odpowiednio kontrolowani. Australijski Komisarz ds. Bezpieczeństwa w Internecie, na przykład, wydał ostrzeżenie, że bez zabezpieczeń chatboty AI mogą narazić dzieci na niebezpieczne treści lub manipulację – od szkodliwych idei i prześladowania, po wykorzystywanie seksualne lub nadużycia poprzez zdobycie zaufania dziecka thedailybeast.com. Pojawia się także obawa, że dzieci mogą stać się zbyt zależne od „przyjaciela” AI lub zacierać granice między relacjami z AI a ludźmi <a href="https://www.thedailybeast.com/prolific-procreator-elon-musk-annouKrytycy wyrazili obawy dotyczące . Jeden tragiczny przypadek opisywany w mediach dotyczył nastolatka z USA, który stał się obsesyjnie zaangażowany w rozmowy z chatbotem AI i odebrał sobie życie, co doprowadziło do pozwu dotyczącego obowiązku zachowania należytej staranności przez bota thedailybeast.com. Te incydenty podkreślają, że AI skierowana do dzieci wymaga ścisłych zabezpieczeń. Jak ujął to jeden z etyków AI, to jak projektowanie nowego rodzaju placu zabaw – z niesamowitymi możliwościami nauki, ale gdzie sprzęt musi być zbudowany tak, by dzieci nie zrobiły sobie krzywdy. Czy „Baby Grok” zdobędzie zaufanie rodziców, dopiero się okaże, ale wyraźnie widać, że dążenie do integracji AI z edukacją i życiem młodzieży przyspiesza.

Dzielenie się zyskami: Wśród wszystkich tych wydarzeń, sami liderzy AI przyznają potrzebę inkluzywnego postępu. W rzeczywistości OpenAI – którego ChatGPT został już pobrany oszałamiające ponad 900 milionów razy na urządzenia mobilne (10× więcej niż jakakolwiek konkurencyjna aplikacja chatbot) qz.com qz.com – właśnie uruchomiło swoją pierwszą dużą inicjatywę filantropijną. Firma ogłosiła fundusz o wartości 50 milionów dolarów na wsparcie organizacji non-profit i społeczności wykorzystujących AI dla dobra społecznego reuters.com. Fundusz ten będzie wspierał projekty wykorzystujące AI w takich obszarach jak edukacja, opieka zdrowotna, wzmacnianie gospodarcze i badania obywatelskie, a był to kluczowy postulat nowej rady ds. „zarządzania” non-profit OpenAI reuters.com reuters.com. Filantropijne ramię OpenAI (które nadal nadzoruje firmę nastawioną na zysk) przez miesiące zbierało opinie od ponad 500 liderów społeczności na temat tego, jak AI może pomóc społeczeństwu reuters.com. Powstały fundusz – który będzie współpracował z lokalnymi organizacjami – ma na celu „wykorzystanie AI dla dobra publicznego” i zapewnienie, że korzyści z tej technologii będą szeroko dostępne, a nie skoncentrowane tylko w centrach technologicznych ts2.tech. To mały, ale symboliczny krok, gdy branża stoi przed kluczowym pytaniem: jak pogodzić zawrotne tempo innowacji z odpowiedzialnością społeczną.

Od sal konferencyjnych wielkich firm technologicznych po laboratoria naukowe, od planów filmowych w Hollywood po sale lekcyjne – ostatnie dwa dni pokazały, że AI dotyka każdego sektora i regionu. W tym 48-godzinnym okresie widzieliśmy, jak autonomiczne agenty przechodzą od koncepcji do komercyjnej rzeczywistości, miliardowe zakłady firm podwajających inwestycje w AI oraz rządy zarówno przyjmujące, jak i ograniczające tę technologię. Zobaczyliśmy także przebłyski obietnic AI – szybsze leczenie nowotworów, tworzenie sztuki i przyspieszanie nauki – łagodzone ostrzeżeniami o jej pułapkach – utracie miejsc pracy, braku przejrzystości i dylematach etycznych. Jak zauważył jeden z komentatorów w tym tygodniu, „Sztuczna inteligencja to nowa elektryczność.” binaryverseai.com Podobnie jak elektryczność na początku XX wieku, szybkie wdrażanie AI budzi tyle samo optymizmu, co niepokoju. Wyzwanie na przyszłość to przekształcenie tej surowej siły w powszechnie dzielony postęp, przy jednoczesnym zapewnieniu bezpieczeństwa systemu dla wszystkich.

Źródła: Informacje zawarte w tym raporcie pochodzą z wielu renomowanych serwisów informacyjnych, oficjalnych komunikatów i komentarzy ekspertów opublikowanych w dniach 19–20 lipca 2025 r. Kluczowe źródła to Reuters reuters.com reuters.com, TechCrunch techcrunch.com, Quartz qz.com oraz specjalistyczne serwisy o AI ts2.tech ts2.tech, a także inne cytowane w całym raporcie.